Korzystanie z publicznie dostępnych narzędzi AI (np. ChatGPT, Gemini) w miejscu pracy, bez posiadania wersji Enterprise, może prowadzić do wycieku poufnych informacji, rosnących kosztów lub nagłej utraty stabilności procesów. Rozwiązaniem może być podejście, które łączy wykorzystanie publicznych narzędzi w połączeniu z lokalnymi modelami.

Ryzyko pracy z narzędziami AI

W pracy z narzędziami AI należy pamiętać o następujących ryzykach:

- Prywatność: właściciele narzędzi chmurowych mają dostęp do wprowadzanych informacji, o ile nie używasz licencji firmowych.

- Koszty: narzędzia posiadają limity (szczególnie dla modeli „myślących”). Zwiększenie ich wymaga płatnych subskrypcji.

- Nieumyślne zapamiętywanie: wersje osobiste domyślnie trenują się na Twoich zapytaniach. Może to prowadzić do tego, że model “powtórzy” dane z Twojej konwersacji w rozmowie z innym użytkownikiem.

- Model drift: korzystasz z wersji narzuconej przez twórcę. Niespodziewane aktualizacje mogą z dnia na dzień zmienić Twój dotychczasowy sposób pracy.

Rozwiązane: lokalnie uruchomione AI, które działa offline i bez abonamentów. Gwarantuje to pełną dyskrecję Twoich informacji.

AI na własnym komputerze

Uruchomienie modelu AI na Twoim komputerze to proces nie wymagający wiedzy technicznej. Umożliwia to m.in. program LM Studio, który pozwala pobierać i uruchamiać otwartoźródłowe modele AI na naszym komputerze i pracować z nimi w formie czatu.

Kiedy lokalne AI to dobry pomysł?

- Brak wersji enterprise: Twoja organizacja nie posiada wersji dla firm narzędzia AI, którego używasz.

- Dane poufne: pracujesz z danymi osobowymi lub tajemnicami firmy.

- Praca offline: często pracujesz bez dostępu do sieci.

- Wystarczające zasoby sprzętowe: posiadasz sprzęt z mocną kartą graficzną lub min. 8 GB RAM.

Instrukcja startu z LM Studio:

- Wejdź na lmstudio.ai i zainstaluj wersję dla swojego systemu.

- Uruchom program

- Przy pierwszym uruchomieniu program zasugeruje pobranie rekomendowanego modelu, pobierz go lub pomiń ten krok

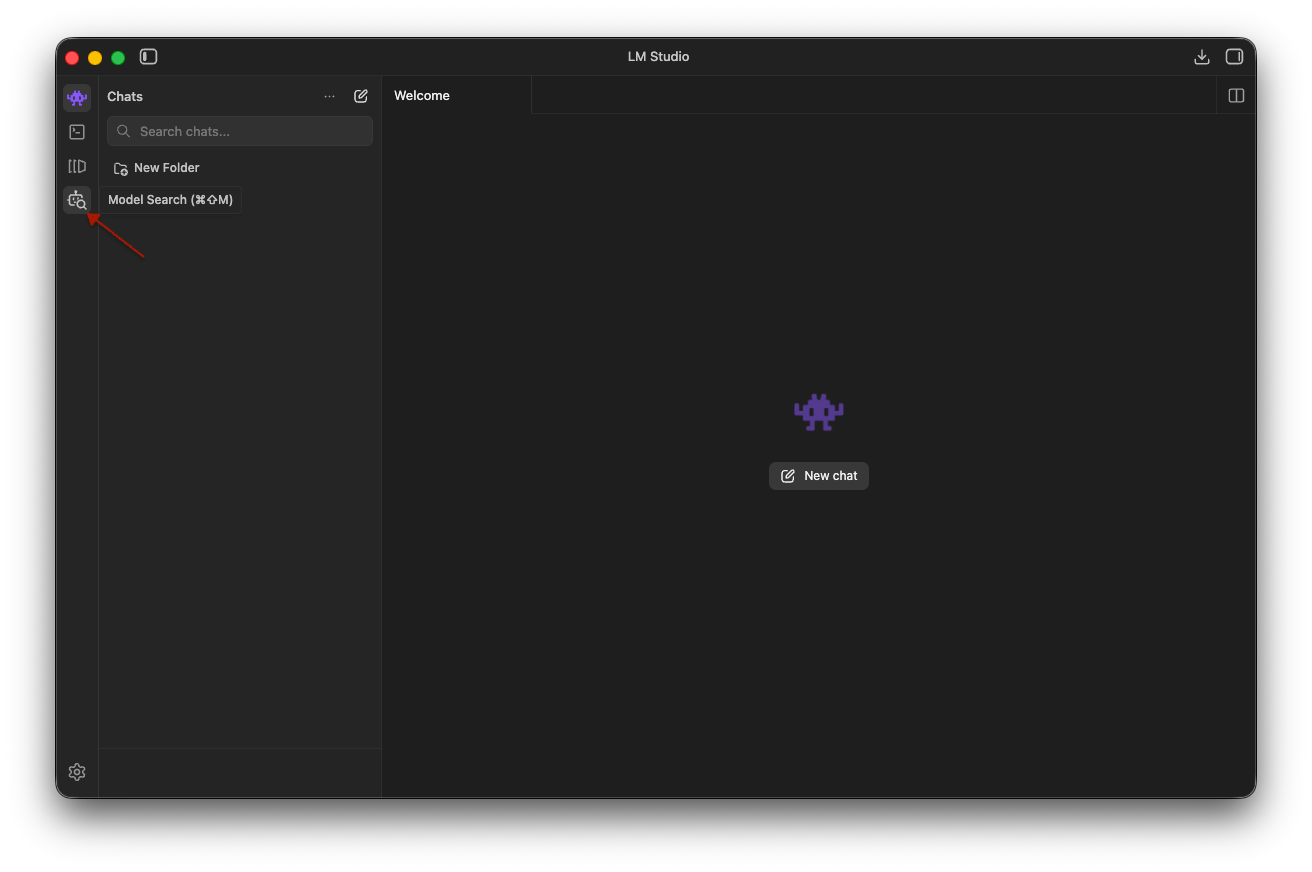

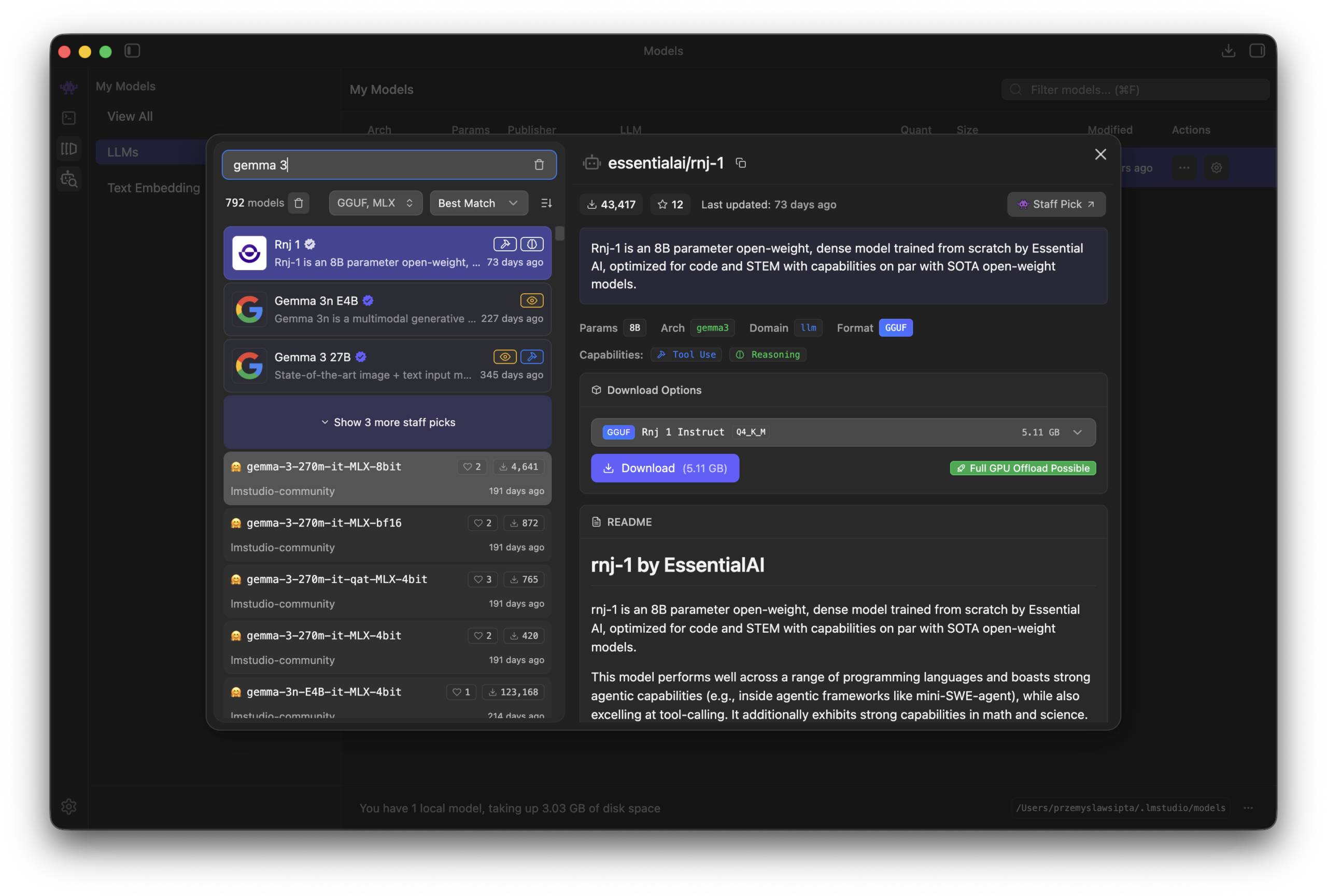

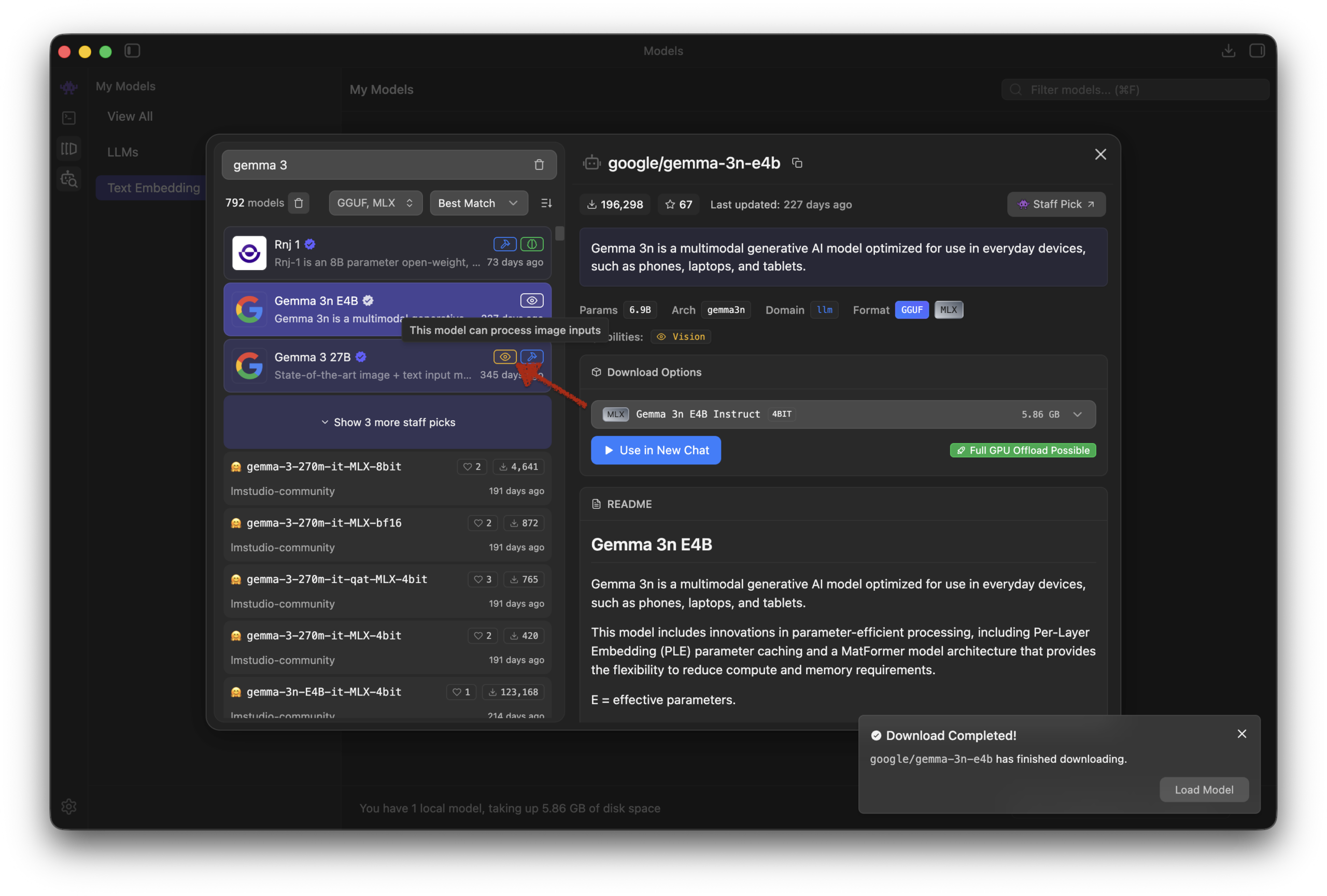

- Jeżeli nie pobrałeś modelu, wybierz zakładkę “Wyszukiwarka modeli” i wyszukaj model do pobrania, np. Gemma 3n E4B

- Gdy model zostanie pobrany, przejdź do sekcji „Chaty”

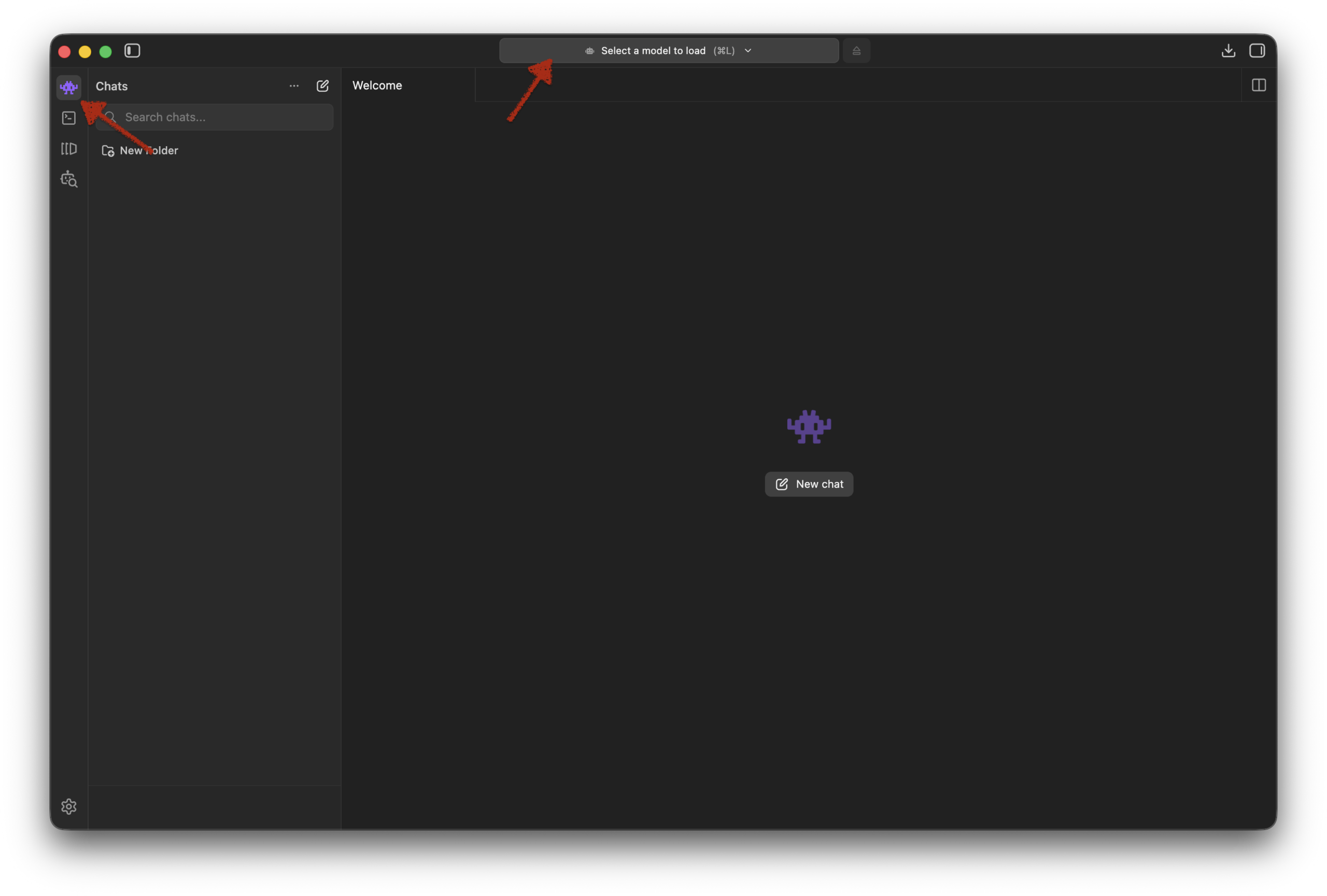

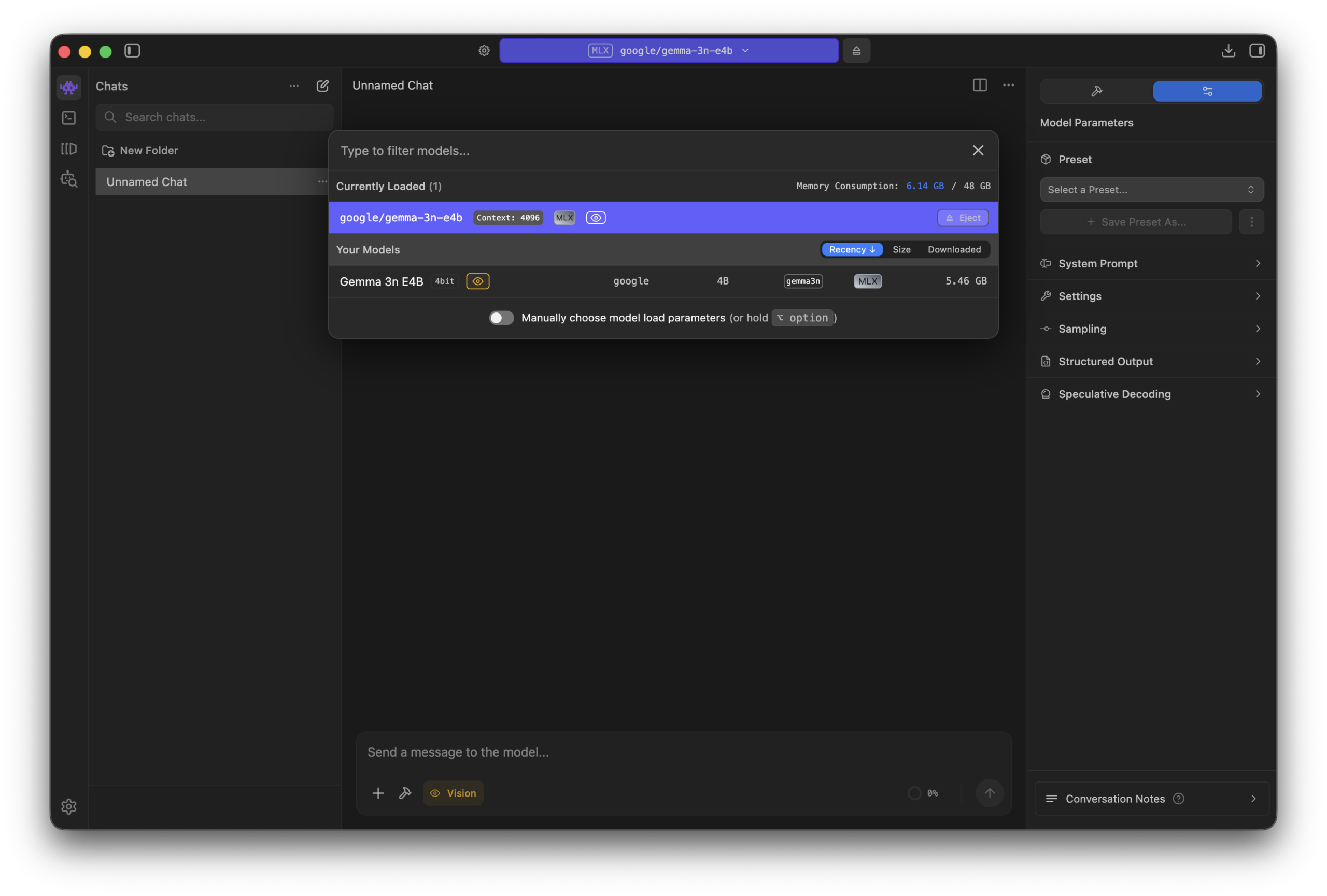

- Wybierz model używając górnego paska wyboru

Po wykonaniu powyższych kroków LM Studio jest gotowe do pracy. Możesz rozpocząć rozmowę z AI w formie czatu. LM Studio oferuje kilka dodatkowych funkcji, które mogą ułatwić Twoją pracę:

- Tworzenie szablonów z zapamiętanymi instrukcjami dla AI

- Dodawanie plików do konwersacji

- Środowisko do uruchamiania kodu w celu wykonania skomplikowanych obliczeń

- Serwer API

- Tryb pacy wykorzystujący kilka modeli jednocześnie

Dobierz AI do swojego sprzętu

Dopasowanie modelu AI do pamięci RAM zapewnia płynną pracę bez zawieszania systemu.

Jak dobrać model w LM Studio:

- Model na start: Zacznij od modelu gemma3n 4B. Jest wystarczająco bystry i zadziała na prawie każdym nowoczesnym komputerze.

- Format GGUF: Wybieraj pliki w tym formacie – są zoptymalizowane pod kątem zwykłych komputerów i laptopów.

- Oznaczenia: zwracaj uwagę na oznaczenia, które informują m.in o tym czy model może pracować w trybie myślącym lub obsługiwać obrazy

Klasyfikacja modeli i wymagania:

| Klasa modelu | Sprzęt | Zastosowanie | Polecany model |

| 4B–10B (Lekkie) | Zwykły laptop (min. 8 GB RAM) | E-maile, anonimizacja danych, prosta obróbka tekstu. | gemma3n 4B |

| 13B–30B (Średnie) | Mocne PC (karta graficzna min. 12 GB VRAM) | Analiza kodu, wyłapywanie niuansów, zaawansowana logika. | DeepSeek-R1 |

| 70B+ (Potężne) | Mac (min. 64 GB RAM) lub 2x RTX 3090/4090 | Złożone raporty, matematyka, burze mózgów. | Llama 3.3 70B |

Przykładowe zastosowania

Możliwości lokalnych modeli AI ograniczają parametry naszego komputera. Jeżeli potrzebujesz używać bardziej zaawansowanych modeli lub konkretnych zewnętrznych narzędzi (np. do tworzenia prezentacji), możesz zastosować podejście hybrydowe.

Jak działa ten proces?

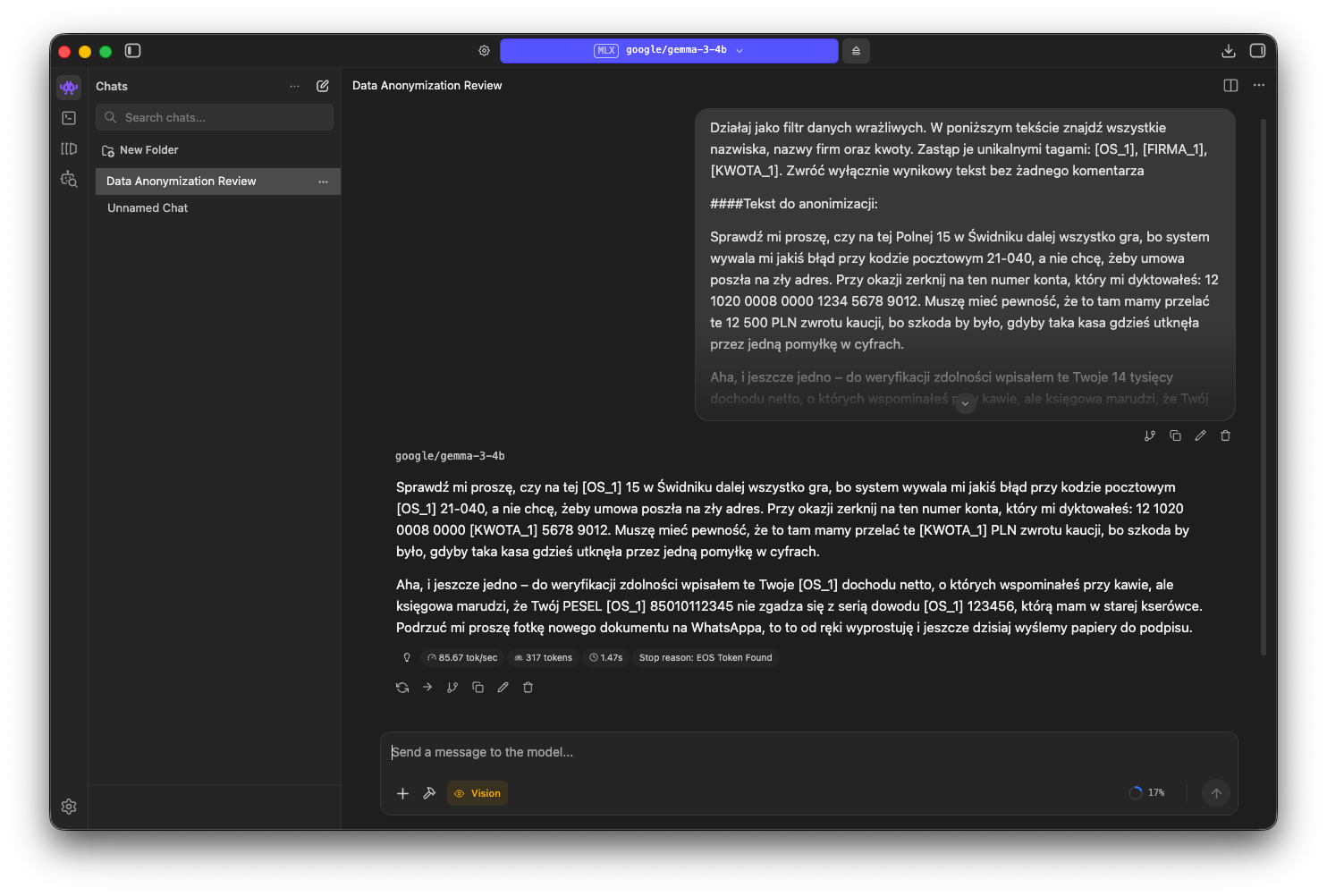

- Czyszczenie lokalne: Używasz lokalnego modelu (np. gemma3n 4B) do wykrycia danych wrażliwych. AI zamienia je na bezpieczne znaczniki, np. [KLIENT_1].

- Praca w chmurze: Tak przygotowany, bezpieczny tekst przesyłasz do zewnętrznego narzędzia (np. ChatGPT) w celu wykonania złożonego zadania.

- Powrót do oryginału: Po otrzymaniu wyniku używasz ponownie lokalnego AI, aby zamienić znaczniki z powrotem na rzeczywiste dane.

Przykładowy prompt:

„Działaj jako filtr danych wrażliwych. W poniższym tekście znajdź wszystkie nazwiska, nazwy firm oraz kwoty. Zastąp je unikalnymi tagami: [OS_1], [FIRMA_1], [KWOTA_1]. Zwróć wyłącznie wynikowy tekst bez żadnego komentarza.”

Inne zastosowania lekkich modeli lokalnych: Nawet mniejsze modele (klasy 4B–10B) bezbłędnie radzą sobie z zadaniami, które nie wymagają dużej mocy obliczeniowej:

- Analiza logów i błędów: Szybkie streszczanie logów serwerowych, które często zawierają wrażliwe ścieżki dostępu lub adresy IP.

- Redagowanie korespondencji: Przygotowywanie ofert handlowych i e-maili, których treść powinna zostać wyłącznie u Ciebie.

- Wstępny brainstorming: Generowanie pomysłów i planów bez obawy o wyciek Twojej własności intelektualnej.

Podsumowanie

Własny lokalny AI to fundament bezpieczeństwa każdego profesjonalisty pracującego z własnością intelektualną.

- Prywatność bez kompromisów: Lokalny model to gwarancja, że Twoje dane biznesowe nigdy nie zostaną wykorzystane do trenowania modeli ani nie wpadną w ręce konkurencji.

- Moc dopasowana do potrzeb: Dzięki obsłudze CPU i GPU oraz różnorodności modeli możesz optymalnie wykorzystać sprzęt, który masz w posiadaniu.

- Niezależność operacyjna: brak subskrypcji, brak limitów wiadomości i możliwość pracy offline.

Zacznij od pobrania modelu klasy 4B w LM Studio i przekonaj się, że najskuteczniejsze AI to takie, nad którymi masz pełną kontrolę.